Razvoj veštačke inteligencije (AI) napreduje neverovatnom brzinom, ali šta se dešava kada visoko sofisticirani modeli poput OpenAI o1 modela postanu predmet kopiranja? Prema izveštajima, kineski istraživači sa Univerziteta Fudan i Šangajske laboratorije za AI uspešno su uz pomoću reverznog inženjeringa, a po čemu su Kinezi inače poznati, uspešno razbili i iskopirali ovaj ChatGPT model. Ovaj napredak označava značajan korak ka razvoju „Opšte veštačke inteligencije“ (AGI), ali otvara i ključna pitanja o bezbednosti i etičnosti otvaranja ovakvih tehnologija.

OpenAI o1 model, poznat kao “Reasoner,” ključan je za OpenAI-ovu petofaznu strategiju na razvojnom AGI putu. Ovaj model se ističe sposobnostima rešavanja složenih problema i temelji se na tri osnovne tehnike:

- Reinforcement Learning (učenje putem nagrađivanja): model se u iteracijama poboljšava nagrađivanjem tačnih odgovora i kažnjavanjem grešaka.

- Search-Based Reasoning (pretraga rešenja): sistematski pristup istraživanju prostora rešenja za efikasno rešavanje kompleksnih problema.

- Iterative Learning (iterativno učenje): stalno usavršavanje kroz cikluse obuke i evaluacije.

Zahvaljujući ovim tehnikama, o1 model postiže preciznost koja često nadmašuje ljudske sposobnosti u specifičnim domenima, otvarajući vrata za napredne AI aplikacije.

Kako su kineski istraživači kopirali model?

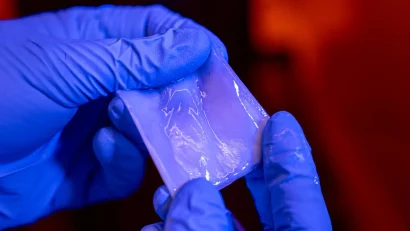

U decembru 2024. godine, tim istraživača iz Kine objavio je studiju u kojoj opisuju proces replikacije OpenAI o1 modela. Korišćenjem sličnih tehnika kao OpenAI – uključujući učenje putem nagrađivanja, pretragu rešenja i iterativno učenje – razvili su sopstvene sisteme za razmišljanje.

Jedna od njihovih ključnih inovacija je upotreba „sintetičkih podataka“ za obuku modela. Ova metoda generiše raznovrsne, visokokvalitetne scenarije koji simuliraju složene probleme teško reprodukovane u stvarnom svetu. Sintetički podaci omogućili su bržu obuku i veću prilagodljivost modela, obuhvatajući širi spektar zadataka.

OpenAI-ova tranzicija ka zatvorenim sistemima

OpenAI se poslednjih godina udaljio od filozofije otvorenog koda, prelazeći na zatvoreniji, profitno orijentisan model. Kompanija navodi sigurnosne rizike i visoke troškove razvoja kao glavne razloge za ovu promenu. Međutim, kritičari tvrde da je ova strategija podstakla zemlje poput Kine da reverznim inženjeringom tehnologije iskopiraju rešenja i otvore ih širu javnost.

Kineski istraživači su svoju repliku učinili otvorenim kodom, što dodatno komplikuje globalni pejzaž AI razvoja. Ovo poteže važna pitanja o balansu između bezbednosti, konkurencije i etike u razvoju i distribuciji moćnih AI tehnologija.

Replikacija OpenAI-ovog o1 modela od strane kineskih istraživača označava prekretnicu u globalnoj trci ka AGI. Dok inovacije poput sintetičkih podataka ubrzavaju napredak, širi kontekst otvorenog ili zatvorenog pristupa tehnologijama, podiže važnost ključnih etičkih i bezbednosnih dilema. Ovaj događaj nagoveštava izazove budućnosti, gde konkurencija i saradnja moraju koegzistirati u svetu sve moćnije veštačke inteligencije, piše Geeky Gadgets.

Nema komentara 😞

Trenutno nema komentara vezanih za ovu vest. Priključi se diskusiji na Benchmark forumu i budi prvi koje će ostaviti komentar na ovaj članak!

Pridruži se diskusiji