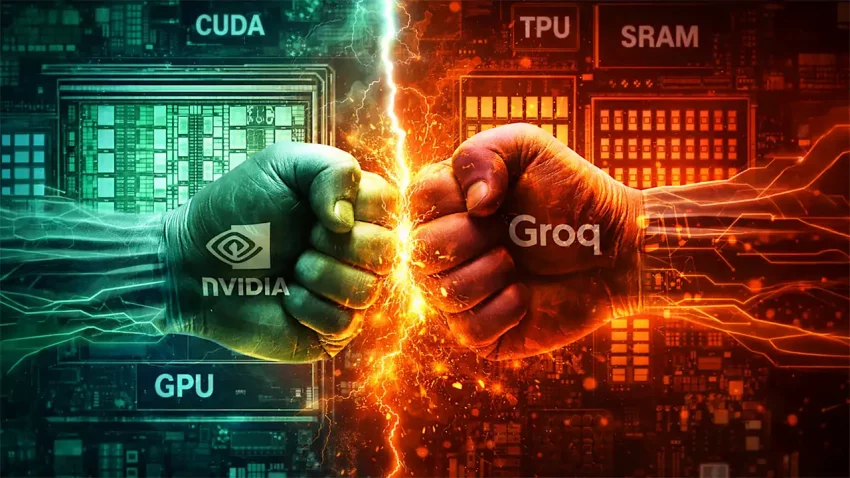

Nvidijin strateški licencni dogovor sa kompanijom Groq, vredan oko 20 milijardi dolara, predstavlja jedan od prvih jasnih signala da se AI industrija nalazi pred velikim preokretom. Za inženjere i tehničke lidere koji danas grade AI sisteme i data centre, ova odluka šalje poruku da se era univerzalnog GPU-a kao standardnog rešenja za AI trening i odluke završava.

Industrija ulazi u fazu razdvojene AI arhitekture izvršavanja, u kojoj se sam silicijum deli na dve specijalizovane kategorije kako bi se odgovorilo na nove zahteve: obradu ogromnog konteksta i izuzetno brzo rezonovanje u realnom vremenu.

Ključni razlog za ovu promenu je sam proces izvršavanja i učenja AI modela. Krajem 2025. godine, izvršavanje AI modela je po prvi put premašio trening modela po ukupnim prihodima u data centrima. Time su se promenili i kriterijumi uspeha. Tačnost je postala osnovni uslov, dok se prava bitka sada vodi oko kašnjenja i sposobnosti sistema da zadrži stanje, što je ključno za autonomne AI agente.

Donošenje zaključaka AI modela se prirodno deli na dve faze. Prva je tzv. „prefill“ faza, u kojoj model „upija“ ogromne količine ulaznih podataka, poput velikih kodnih baza ili dugih video zapisa. Ova faza je izrazito računarski zahtevna i tu su GPU-ovi tradicionalno bili jaki. Druga faza je „decode“, odnosno generisanje odgovora token po token, gde je presudna brzina pristupa memoriji. Tu klasični GPU-ovi pokazuju ograničenja, a upravo tu dolazi do izražaja Groq-ova arhitektura zasnovana na SRAM memoriji.

Zašto proces AI treninga razbija klasičnu GPU arhitekturu

Nvidia je već najavila novu generaciju čipova iz porodice Vera Rubin, koji su projektovani upravo za ovakvu podelu posla. Prefill deo će koristiti pristupačniju GDDR7 memoriju za obradu ogromnih konteksta, dok će se za izuzetno brzu generaciju tokena oslanjati na specijalizovana rešenja inspirisana Groq tehnologijom.

SRAM memorija, koja je fizički ugrađena u sam procesor, omogućava ekstremno brzu obradu uz minimalnu potrošnju energije. Međutim, ona je skupa i ograničena prostorom, zbog čega je idealna za manje, ali brze modele, naročito u oblastima kao što su robotika, glasovne komande, IoT uređaji i edge AI. Upravo taj segment tržišta do sada nije bio adekvatno pokriven klasičnim GPU rešenjima.

Dodatni pritisak na Nvidiju dolazi i iz softverskog sveta. Uspeh kompanije Anthropic u razvoju prenosivog AI steka, koji bez većih problema radi i na GPU-ovima i na TPU-ovima, pokazao je da se zavisnost od jednog proizvođača može veoma lako razbiti. Nvidia dogovor sa Groq-om ima i jasnu defanzivnu ulogu: zadržati najosetljivije zadatke unutar CUDA ekosistema.

Posebno važan aspekt cele priče je stanje AI agenata, odnosno njihova sposobnost da pamte prethodne korake. U modernim agentnim sistemima, odnos ulaznih i izlaznih tokena može biti i 100 prema 1, što čini memoriju ključnim resursom. Ako se to stanje izgubi, sistem mora da troši ogromnu količinu energije da bi ga ponovo izračunao. Upravo tu SRAM i hijerarhijska memorijska rešenja dobijaju presudnu ulogu.

Zaključak za 2026. godinu je jasan: industrija ulazi u eru ekstremne specijalizacije. Umesto jednog dominantnog čipa, budućnost pripada arhitekturama koje precizno razdvajaju zadatke i šalju ih na odgovarajući hardverski nivo za potrebe brže obrade. Strategija više nije pitanje koji GPU je kupljen, već gde je svaki token obrađen i zašto, piše Zencoder.

Smejurija, vratice se era samo tako..

Groktaće i ko neće! 😂

Mene više čudi da do sada nisu otišli u tom pravcu, isto kao što je mining otišao na ASIC-e za mininig i tu grafičke nemaju šta da traže tako i AI mora da ode u tom smeru. Jedino logično. Šta će njemu RT, shading ROP i ostalo da računa matrice.

Инспиративан чланак који тера на размишљање, о томе где ће ићи развој технологије.

Оно што се зна је... да ће бити много различитих чипова! А не као данас Нвидија, АМД, Интел и ништа више. Свако битан у свету, прави своје чипове и правиће.