Niko u industriji nije preterano srećan zbog potpune zavisnosti od Nvidia čipova za AI trening, iako mnoge kompanije osećaju da nemaju pravi izbor. Apple je međutim, krenuo drugačijim putem i izgleda da je zadovoljan rezultatima: odlučio se za Google TPU hardver za treniranje svojih velikih jezičkih modela. To znamo jer je istraživački rad o procesima koje je koristio za razvoj Apple Intelligence funkcija.

Apple je otkrio iznenađujuću količinu detalja o tome kako je razvijao svoje Apple Intelligence funkcije u svom novom, objavljenom istraživačkom radu. Glavna vest je da je Apple izabrao Google TPU-ove – konkretno TPU v4 i TPU v5 verziju procesora – umesto Nvidia GPU-ova za treniranje svojih modela. To je odstupanje od industrijskih normi jer mnogi drugi LLM-ovi, poput onih iz OpenAI-a i Meta-e, obično koriste Nvidia GPU-ove.

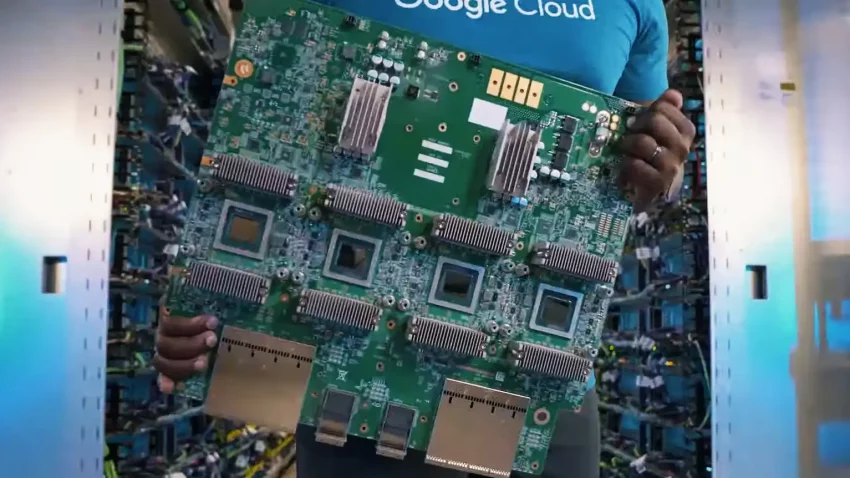

Za neupućene, Google prodaje pristup TPU-ovima preko svoje Google Cloud Platforme. Korisnici moraju napraviti softver na ovoj platformi, kako bi koristili čipove. Evo pregleda onoga što je Apple uradio.

Apple ima više poverenja u Google tehnologiju

Najveći jezički model Apple-a, AFM-server, bio je treniran na 8192 Google TPU v4 procesora konfigurisanih u 8 delova od po 1024 čipova, međusobno povezanih putem mreže data centra. Proces mašinskog učenja za AFM-server podrazumevao je tri faze: počevši sa 6,3 triliona tokena, zatim 1 trilion tokena i završavajući sa produženim kontekstom, koristeći 100 milijardi tokena.

AFM-on-device model, bio je destilovan sa 6,4 milijardi parametara server modela na model od 3 milijarde parametara. Ovaj model je bi treniran na klasteru od 2048 Google TPU v5p procesora.

Apple je koristio podatke sa svog Applebot web crawlera, poštujući robots.txt, zajedno sa raznim licenciranim visokokvalitetnim skupovima podataka. Takođe, korišćeni su odabrani kodovi, matematički i javni skupovi podataka.

Prema internom testiranju Apple-a, i AFM-server i AFM-on-device modeli pokazali su dobre rezultate na benchmark testovima.

Nekoliko stvari treba napomenuti. Prvo, detaljno otkrivanje u istraživačkom radu je značajno za Apple, kompaniju koja nije poznata po svojoj transparentnosti. To ukazuje na značajan napor da se javnosti prikažu i približe njihova dostignuća u AI.

Drugo, izbor Google TPU-ova je zanimljiv. Nvidia GPU-ovi su izuzetno traženi u AI oblasti za potrebe treniranja modela. Google je verovatno imao bržu dostupnost TPU-ova koje je Apple mogao brzo da iskoristi kako bi ubrzao svoj AI razvoj, koji inače već kasni na tržištu.

Google Cloud

Google CloudTakođe je intrigantno da je Apple otkrio da Googleovi TPU v4 i TPU v5 čipovi pružaju potrebnu računsku snagu za treniranje njihovih LLM-ova. Čini se da 8192 TPU v4 procesora na kojima je treniran AFM-server model, nude performanse sasvim uporedive sa Nvidia H100 GPU-ovima za ovaj ozbiljan radni zadatak.

Kao i mnoge druge kompanije, Apple je prilično oprezan kako ne bi previše zavisio od proizvoda kompanije Nvidia, a sa kojom je imao dosta problematično iskustvo u prošlosti kada je njihove GPU proizvode ugrađivao u svoju liniju Mac računara. Za kompaniju koja je pedantna u održavanju kontrole nad svojim tehnološkim postupkom, odluka da se ide sa Google hardverom je posebno smislen izbor i stvar bez presedana u ovom delu industrije, prenosi TechSpot.

Nema komentara 😞

Trenutno nema komentara vezanih za ovu vest. Priključi se diskusiji na Benchmark forumu i budi prvi koje će ostaviti komentar na ovaj članak!

Pridruži se diskusiji