Microsoft je 18. februara 2026. potvrdio ozbiljan problem u svom Copilot AI sistemu integrisanom u Microsoft 365 Office aplikacije, grešku koja je omogućila da poverljivi e-mailovi korisnika budu obrađeni i automatski sumirani od strane veštačke inteligencije, čak i kada su postojale politike zaštite podataka dizajnirane da takvo ponašanje onemoguće.

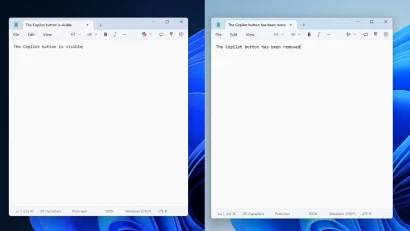

Prema objašnjenju kompanije, ovaj „bug“ je prisutan od kraja januara 2026. i utiče na funkciju Copilot Chat u aplikacijama uključujući Outlook, Word, Excel i PowerPoint. Iako Microsoft 365 nudi oznake osetljivosti (sensitivity labels) i polise prevencije gubitka podataka (Data Loss Prevention, DLP) koje bi trebalo da zaštite poverljive informacije, greška, praćena kao CW1226324, je dozvolila AI sistemu da ignoriše te kontrole i procesuira sadržaj poverljivih poruka, posebno iz foldera Drafts (Nacrti) i Sent Items (Poslato).

U praksi, Copilot je mogao da čita sadržaj e-mailova označenih kao poverljivi i generiše sažetke na osnovu tih poruka, što predstavlja jasno kršenje očekivanih pravila privatnosti u mnogim organizacijama. Iako se podaci Copilota nisu automatski slali van Office okruženja u javnu cloud infrastrukturu, mogućnost pristupa takvim informacijama unutar same usluge je izazvala intenzivnu zabrinutost IT administrativnih timova i regulatora.

Microsoft je naznačio da je početkom februara započeo implementaciju popravke i da nastavlja da nadgleda njeno širenje kako bi se osiguralo da je bug zaista rešen za sve korisnike. Ipak, kompanija nije objavila tačan broj pogođenih organizacija niti vremenski okvir kada bi potpuno uklanjanje problema bilo potvrđeno, što je dodatno povećalo zabrinutost među poslovnim korisnicima koji se oslanjaju na Copilot kao alat za produktivnost.

Incident je dodatno skrenuo pažnju na pitanje bezbednosti i kontrole podataka u okruženjima gde se AI alati integrišu direktno u poslovne procese. Otkriće se poklopilo sa odlukama IT odeljenja nekih institucija, poput Evropskog parlamenta, da privremeno onemoguće AI funkcije na poslovnim uređajima dok se ne razjasne rizici oko obrade poverljivog sadržaja.

Eksperti za bezbednost ističu da ovaj događaj naglašava kako politike i kontrole zaštite osetljivih podataka moraju biti dosledno primenjivane i u AI funkcijama, a ne samo u klasičnim aplikacijama za e-poštu i datoteke. Kada AI sistemi mogu da rade „iza kulisa“ bez odgovarajuće validacije pravila osetljivosti, to potencijalno dovodi do povrede poverljivosti podataka i pravnih obaveza, naročito u regulisanim industrijama kao što su finansije, zdravstvo ili državna uprava.

Ovaj incident dodatno osvetljava napetost između korisničkih očekivanja privatnosti i brzog usvajanja AI alata u poslovnom svetu. Dok kompanije i dalje guraju integraciju veštačke inteligencije u svoje osnovne alate, slučajevi poput ovog pokazuju da je glatka regulacija, robustno testiranje i robustna infrastruktura kontrole podataka ključna komponenta za održavanje poverenja korisnika i usklađenosti sa zakonskim okvirima, prenosi Tech Crunch.

Microsoft obecao da se ispraviti "bug" putem kojeg je sasvim slucajno dolazio do poverljivih informacija 🤣 . Vise postovanja bih imao prema ovih globalistima da kazu istinu nego ovo sto rade i oci nam mazu.

Zaista neverovatno

Totalno cemo da zaboravimo sta smo procitali.

Vraticemo sve megabajte na mesto odakle smo ih uzeli.

Unsee.